谷歌揭开“嵌套学习”范式:让AI像人脑一样分析

发布时间:2025-11-10 10:11

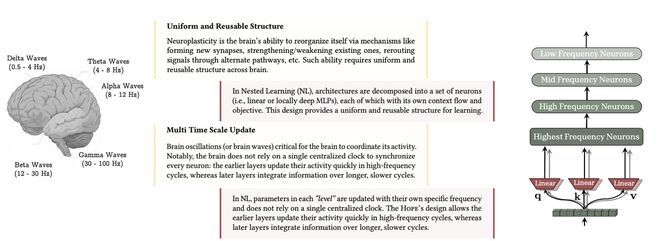

IT之家11月10日报道 谷歌研究院11月7日发表博文,介绍了一种名为“嵌套学习”的新机器学习范式,以克服AI模型在不断学习新知识时遇到的“灾难性遗忘”问题。尽管当前的大规模语言模型很强大,但它们的知识仍然仅限于预训练数据或有限的上下文窗口。他们无法像人脑一样通过“神经可塑性”(神经可塑性,指大脑根据经验、学习和环境变化来调整自身结构和功能的能力),在不忘记旧知识的情况下继续学习新技能。如果直接用新数据更新模型,这往往会导致“灾难遗忘”(disasterforgettingan),即在学习了一个新任务后,旧任务的性能受到严重打击。为了解决这一根本挑战,谷歌研究院的研究人员提出了一种新的解决方案。我在 Neurips 2025 上发表的一篇论文中,谷歌引入了“嵌套学习”范式。该范式从根本上结合了架构模型和优化算法,这两个概念传统上是分开对待的。该范式认为,复杂的机器学习模型本质上是一系列相互嵌套或并行的优化问题,每个问题都有自己独立的“上下文流”和更新率。这一愿景提出了一种新的设计规模,使研究人员能够构建具有深度计算深度的人工智能组件,从而有效简化被遗忘的灾难问题。基于嵌套学习范式,研究团队提出了两项具体的技术改进:一是“深度优化”,将优化器本身视为一个学习模块,改进其底层目标函数,使其在不完美数据中更加稳定(系统或流程在面对不完美数据时保持功能和稳定性能的能力)。不确定性、变化、不正确的输入或不稳定的条件)。二是“记忆系统的连续性”(CMS),它将记忆模型视为由许多不同更新频率的模块组成的谱,从短期记忆到长期记忆的平滑过渡,创造出更丰富、更好的持续学习记忆系统。为了证明上述理论,研究团队设计并实现了一个名为“Hope”的概念验证模型。 Hope是一个基于Titans架构的自修改循环网络。它与连续记忆系统(CMS)深度集成,可以通过自我参照过程优化自身记忆,实现近乎无限水平的情境学习。在一系列公共建模语言和常见推理任务中,希望架构比现代循环模型和标准变压器实现了更低的混乱和显着更高的准确性。尤其是在“大海捞针”(NIA)测试中H)在测试中,霍普表现出了良好的记忆管理能力,证明连续记忆系统是处理超序列信息的有效解决方案,为实现真正“温故而知新”的人工智能铺平了道路。 NIAH 是一项基准测试,用于评估大型语言模型的长文本理解和信息检索能力。这就要求模型能够从很长的文本(大海捞针)中准确地找到并回答特定的信息点(针)。附有参考资料

特别声明:以上内容(如有则包括照片或视频)由自媒体平台“网易号”用户上传发布。本平台仅提供信息存储服务。

注:以上内容(包括图片和视频,如有)由网易HAO用户上传发布,网易HAO为社交媒体平台,仅提供信息信息存储服务。

IT之家11月10日报道 谷歌研究院11月7日发表博文,介绍了一种名为“嵌套学习”的新机器学习范式,以克服AI模型在不断学习新知识时遇到的“灾难性遗忘”问题。尽管当前的大规模语言模型很强大,但它们的知识仍然仅限于预训练数据或有限的上下文窗口。他们无法像人脑一样通过“神经可塑性”(神经可塑性,指大脑根据经验、学习和环境变化来调整自身结构和功能的能力),在不忘记旧知识的情况下继续学习新技能。如果直接用新数据更新模型,这往往会导致“灾难遗忘”(disasterforgettingan),即在学习了一个新任务后,旧任务的性能受到严重打击。为了解决这一根本挑战,谷歌研究院的研究人员提出了一种新的解决方案。我在 Neurips 2025 上发表的一篇论文中,谷歌引入了“嵌套学习”范式。该范式从根本上结合了架构模型和优化算法,这两个概念传统上是分开对待的。该范式认为,复杂的机器学习模型本质上是一系列相互嵌套或并行的优化问题,每个问题都有自己独立的“上下文流”和更新率。这一愿景提出了一种新的设计规模,使研究人员能够构建具有深度计算深度的人工智能组件,从而有效简化被遗忘的灾难问题。基于嵌套学习范式,研究团队提出了两项具体的技术改进:一是“深度优化”,将优化器本身视为一个学习模块,改进其底层目标函数,使其在不完美数据中更加稳定(系统或流程在面对不完美数据时保持功能和稳定性能的能力)。不确定性、变化、不正确的输入或不稳定的条件)。二是“记忆系统的连续性”(CMS),它将记忆模型视为由许多不同更新频率的模块组成的谱,从短期记忆到长期记忆的平滑过渡,创造出更丰富、更好的持续学习记忆系统。为了证明上述理论,研究团队设计并实现了一个名为“Hope”的概念验证模型。 Hope是一个基于Titans架构的自修改循环网络。它与连续记忆系统(CMS)深度集成,可以通过自我参照过程优化自身记忆,实现近乎无限水平的情境学习。在一系列公共建模语言和常见推理任务中,希望架构比现代循环模型和标准变压器实现了更低的混乱和显着更高的准确性。尤其是在“大海捞针”(NIA)测试中H)在测试中,霍普表现出了良好的记忆管理能力,证明连续记忆系统是处理超序列信息的有效解决方案,为实现真正“温故而知新”的人工智能铺平了道路。 NIAH 是一项基准测试,用于评估大型语言模型的长文本理解和信息检索能力。这就要求模型能够从很长的文本(大海捞针)中准确地找到并回答特定的信息点(针)。附有参考资料

特别声明:以上内容(如有则包括照片或视频)由自媒体平台“网易号”用户上传发布。本平台仅提供信息存储服务。

注:以上内容(包括图片和视频,如有)由网易HAO用户上传发布,网易HAO为社交媒体平台,仅提供信息信息存储服务。 下一篇:没有了